Роман Викторович Душкин

Искусственный интеллект

Именно Джон Маккарти сформулировал основополагающие принципы искусственного интеллекта, определив то, что потом было названо «чистым подходом», или «нисходящим искусственным интеллектом», и выразилось в гипотезе Ньюэлла-Саймона о том, что осмысленные действия можно выполнять только при наличии в некоторой системе механизма символьных вычислений, а сами такие символьные вычисления являются необходимым условием наличия в этой системе интеллекта. Другими словами, подход Джона Маккарти выражался в том, что системы искусственного интеллекта должны имитировать высокоуровневые психологические процессы разумного существа, такие как логическое мышление, логический вывод, речь, творчество и т. д.

С другой стороны, его друг и коллега Марвин Мински сформулировал совершенно противоположное определение искусственного интеллекта, которое получило наименование «грязного подхода», или «восходящего искусственного интеллекта». В основе этой парадигмы лежит попытка моделирования естественных процессов, происходящих в самой природе человека. В первую очередь это, конечно же, моделирование нейросетевых процессов в разных аспектах. Наиболее широко проявившейся технологией в рамках грязного подхода стали искусственные нейронные сети, которые моделируют разные процессы человеческого разума на логическом уровне. Можно было бы попробовать смоделировать биохимический уровень, однако для этого не хватает вычислительных мощностей даже сегодня, не говоря уже про те давние времена. Другой известной технологией являются различные генетические и эволюционные методы решения задач. Но в целом этот подход не является «искусственным интеллектом» в том понимании Джона Маккарти, как он определил данный термин.

При этом необходимо понимать, что первоначально предназначением той междисциплинарной области исследований, которая получила название «искусственный интеллект», было моделирование когнитивных функций человека для их исследования на модели, чтобы понять природу интеллекта, разума и сознания человека. Другими словами, искусственный интеллект первоначально рассматривался как довольно фундаментальная область исследований, и только через какое-то время появилась задача по практическому применению наработок, которая нашла своё отражение в создании большого количества искусственных систем, решающих задачи, традиционно относившиеся к прерогативе человека.

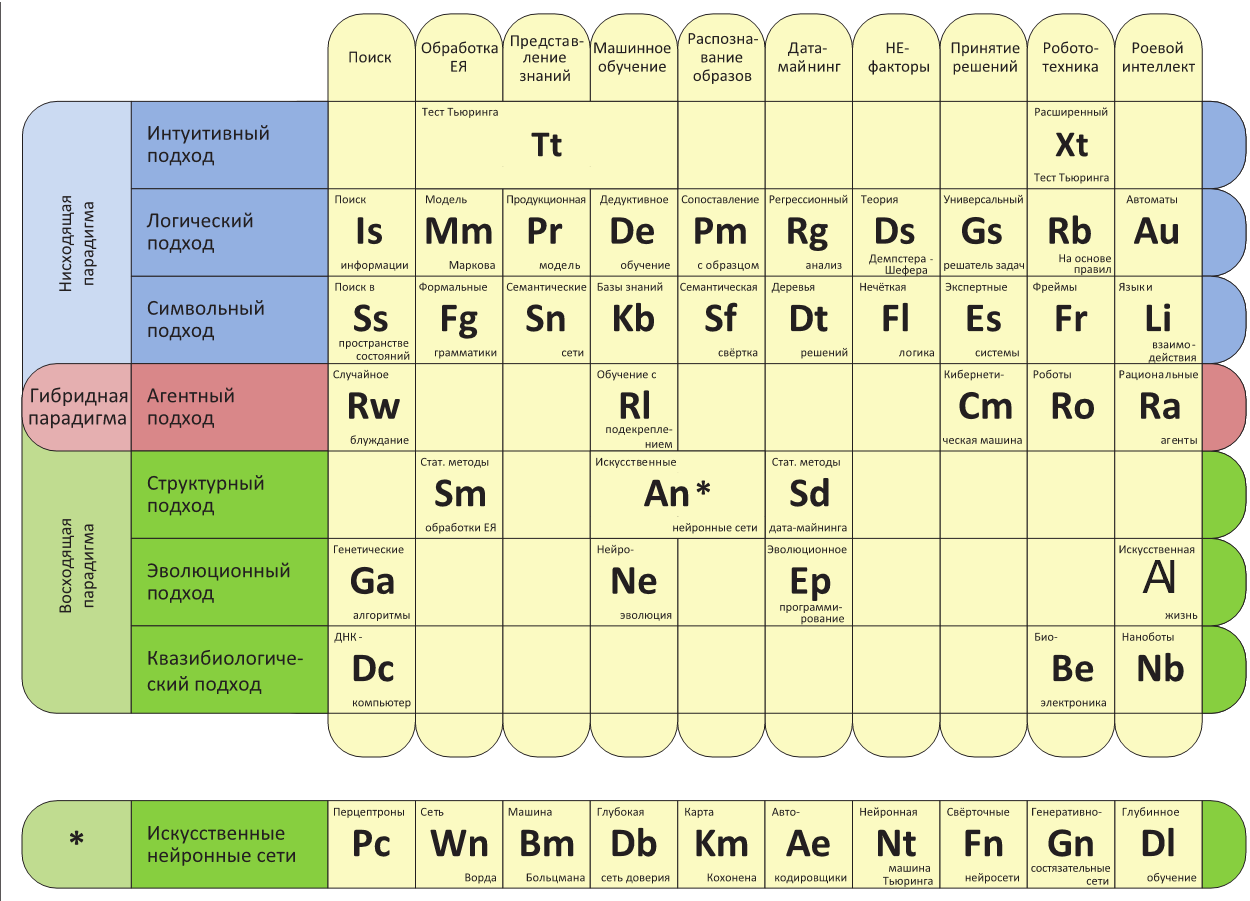

Фактически две парадигмы, описанные выше, лежат в основе всякого подхода к разработке искусственного интеллекта. На сегодняшний день таких подходов выделяют семь:

1) интуитивный;

2) логический;

3) символьный;

4) структурный;

5) эволюционный;

6) квазибиологический;

7) агентный.

Надо отметить, что агентный подход к разработке искусственного интеллекта чаще всего рассматривается в рамках так называемой гибридной парадигмы, которая представляет собой смесь нисходящей и восходящей парадигм, берет из них лучшее и старается нивелировать отрицательные стороны. Гибридная парадигма и агентный подход будут рассмотрены в самом конце этой главы.

Интересно то, что в рамках искусственного интеллекта, который, как уже было отмечено, является междисциплинарным научным направлением исследований, имеется ряд задач, которые решаются методами всех или некоторых перечисленных подходов. В частности, к таким задачам традиционно относят:

• поиск информации;

• обработка естественного языка;

• представление знаний;

• машинное обучение;

• распознавание образов;

• интеллектуальный анализ данных, или «дата-майнинг»;

• обработка НЕ-факторов знания;

• принятие решений;

• робототехника;

• роевой интеллект.

Нельзя сказать, что это полный и консистентный список задач, к тому же некоторые из представленных задач в какой-то части пересекаются. Тем не менее это хороший список, являющийся анкером, от которого можно отталкиваться при изучении подходов и методов искусственного интеллекта. Другие исследователи могут предлагать иной список и классификацию задач, но далее в этой книге будет рассматриваться решение именно этих задач разными методами искусственного интеллекта, составляющими те или иные подходы в рамках одной из трёх парадигм.

Что интересно, если попытаться расположить в матрице подходы и парадигмы в строках, а решаемые задачи в столбцах, то получится своеобразная «периодическая система технологий искусственного интеллекта», в ячейках которой будут перечислены различные методы конкретного подхода для решения конкретной задачи. Вот так может выглядеть такая матрица.

Периодическая система технологий искусственного интеллекта

Далее в этой книге во второй главе описано большинство представленных методов решения типовых задач искусственного интеллекта. Ну а пока рассмотрим каждый из перечисленных подходов к построению искусственных интеллектуальных систем подробнее.

Интуитивный подход к искусственному интеллекту был предложен Аланом Тьюрингом в своей ставшей уже знаменитой статье «Вычислительные машины и разум», опубликованной в 1950 г. В ней он предложил процедуру, которая, по его мнению, должна определить на интуитивном уровне, обладает некоторая система интеллектом или нет. Впоследствии эта процедура получила наименование «тест Тьюринга», подвергалась многочисленной критике, была расширена для систем с богатым набором сенсоров и, в общем, дожила до наших дней в качестве вполне себе операционной процедуры. Тем не менее сам подход не является конструктивным, поскольку Тьюринг нигде не говорил о том, как построить интеллектуальную систему.

Честно говоря, сам Тьюринг изложил свой тест немного путано (да ещё и в нескольких вариантах), так что сегодня исследователи ломают копья на тему того, каким образом интеллектуальная система должна проходить данный тест. Но большинство исследователей сходится в одном: прохождение системой теста Тьюринга – необходимый фактор для того, чтобы признать за системой наличие интеллекта, но отнюдь не достаточный. Впрочем, и с этим утверждением многие будут спорить, так как сама природа человеческого интеллекта до сих пор не ясна, потому и бессмысленна разработка какого-либо теста для проверки на наличие интеллекта, «похожего на человеческий». Тем более что основная критика интуитивного подхода заключается в том, что моделирование естественного интеллекта не является единственной возможностью создания интеллектуальной системы. Искусственный интеллект может быть построен на совершенно иных принципах, как это ранее бывало со многими иными изобретениями (колесо для передвижения, реактивная тяга для полёта по воздуху, радиоволны для систем связи и т. д.).

Тем не менее, несмотря на то что тест Тьюринга и интуитивный подход в целом не могут считаться серьёзными инструментами в вопросе разработки искусственного интеллекта, сам по себе тест Тьюринга позволяет определить тот минимальный набор технологий и решаемых задач, которые должна обеспечивать система, чтобы считаться интеллектуальной. Кратко перечислим их.

1. Обработка естественного языка: интеллектуальная система должна уметь общаться с человеком на естественном языке, воспринимая все его неоднозначности, неопределённости и умолчания.

2. Представление знаний: в рамках искусственного интеллекта должны быть представлены как общие, так и специальные знания, при этом система должна постоянно обучаться и пополнять свою базу знаний, в том числе и в процессе диалога с человеком.

3. Логический вывод: используя знания и получаемые на вход запросы от человека, интеллектуальная система должна осуществлять правдоподобный логический вывод, который позволяет сформировать ответ на том же естественном языке. 4. Машинное обучение: система искусственного интеллекта должна быть адаптивной и приспосабливаться к меняющейся ситуации в общении, используя имеющиеся у неё знания в качестве шаблонов и применяя их к схожим ситуациям и, само собой разумеется, актуализируя по результатам свои знания об окружающей среде.

5. Дополнительные сенсоры и исполнительные устройства используются в так называемом «полном тесте Тьюринга», в котором система искусственного интеллекта должна действовать в естественной среде обитания человека, воспринимая её при помощи таких же датчиков, какие есть у человека (видеокамеры, аудиосенсоры, газоанализаторы и др.), и воздействуя на среду при помощи разного рода манипуляторов.

Перечисленное уже наводит на размышления о том, что тест Тьюринга направлен на выявление того, что искусственный интеллект должен успешно «мимикрировать» под человека, хотя для наличия интеллектуальных способностей это совершенно не требуется. Ни одна из перечисленных технологий сама по себе не необходима для того, чтобы считать искусственный объект интеллектуальным. Но в целом наличие этих пяти пунктов с прохождением полного теста Тьюринга позволяет говорить о том, что система может иметь интеллект, похожий на человеческий.

Логический подход основывается на формальной логике. Ведь ещё древнегреческий философ Аристотель сделал успешную попытку формального описания законов человеческого мышления. Сложно сказать, насколько эти законы универсальны, ведь кроме человеческого мышления у нас нет никаких иных примеров, но общее осмысление данного вопроса подсказывает, что формальная логика относится к чистому математическому знанию, т. е. находится в мире чистых идей, а потому может быть общезначимой. Другими словами, мышление, основанное на формальной логике Аристотеля, может быть универсальным, а потому реализация логических правил в искусственной системе может сделать её интеллектуальной. Однако тут имеется та же самая ловушка, как и в случае интуитивного подхода к искусственному интеллекту. Логическое мышление является необходимым условием, но никак не достаточным. Система, обладающая разумом, будет показывать поведение, подчиняющееся законам формальной логики. Но если какая-либо система действует по этим законам, это совсем не значит, что она интеллектуальна.

В рамках математики разработано большое количество формализмов, описывающих логику. Двоичная логика Аристотеля является базовой, над которой надстроены такие варианты, как многозначная логика Лукасевича, нечёткая логика Заде, бесконечнозначная логика антиномий, интуиционистская логика и некоторые другие. Каждый новый формализм был разработан для того, чтобы учесть какие-либо нюансы человеческого мышления и способа принятия решений человеком. Ведь в процессе исследований в направлении логического подхода становилось понятным, что двоичная логика, хотя и является универсальным инструментом размышления и вывода знаний, плохо справляется с такими простейшими аспектами человеческого поведения, как принятие решений в условиях неопределённости, неполноты знания, неточности измерений и т. д.

Однако логический подход сталкивается с серьёзными трудностями, когда возникает необходимость описания неформальных знаний, которые плохо формализуются. Более того, из-за неполноты нашего понимания природы человеческого мышления логический подход всё так же страдает от невозможности полностью описать процесс мышления и принятия решений. Такие феномены, как озарение, интуитивный поиск решения или эмоциональные влияния на принятие решений, не могут быть описаны в рамках логического подхода, хотя они, вне всяких сомнений, являются одним из компонентов человеческого разума.

Тем не менее логический подход составляет основу упомянутой ранее нисходящей парадигмы искусственного интеллекта.

Символьный подход ставит во главу искусственного интеллекта способность человека манипулировать символами (в общем понимании этого термина) при осуществлении своей интеллектуальной деятельности. Тут нужно вспомнить термин «вторая сигнальная система», предложенный русским физиологом Иваном Петровичем Павловым для описания абстрактной системы обозначений, которые используются при мышлении человеком в отрыве от непосредственных ощущений, получаемых всеми сенсорными подсистемами нервной системы. Именно наличие второй сигнальный системы, по мнению некоторых исследователей, отличает разумное существо от животного.

Для упрощения рассмотрим кибернетическую цепочку возникновения реакции человека на стимул из внешней среды на примере зрения. Фотоны различной длины волны попадают на рецепторы сетчатки глаза, где запускают каскад биохимических реакций, результат которых заключается в генерации нервного импульса, идущего по глазному нерву в нервные центры в головном мозге человека. Далее этот импульс диспетчеризуется в ядрах зрительного перекрёста и таламусе, после чего попадает в различные зоны коры головного мозга – первичную зрительную кору, вторичную зрительную кору и т. д., пока след от этого импульса не будет обработан в высших слоях неокортекса, где, как предполагается, и осуществляется манипуляция символами. Именно здесь конкретные каскады биохимических реакций в клетках сетчатки и всех промежуточных нейронах каким-то образом преобразуются в абстрактные символы, имеющие огромное количество ассоциативных связей. И когда человек видит, скажем, кошку, то в его памяти возникают различные образы, именно на символьном уровне связанные с понятием «Feliscatus» («кот домашний», биологическое наименование вида). Человек осознаёт именно эти образы и ассоциативные связи, но никак не осознаёт лежащих в их основе электрофизических и биохимических процессов. Так что разум человека, его интеллект оперирует именно символом «кот домашний», пробегая по отдельным ассоциативным связям, выбор которых зависит от текущего контекста.

Обработка символов построена на выполнении правил различного вида. В дальнейшем мы рассмотрим несколько формализмов, которые конкретизируют и реализуют символьный подход к искусственному интеллекту. Однако все они основаны именно на манипулировании символами как синтаксическими конструкциями. Особенно это касается математических формул, поскольку наибольших успехов символьный подход достиг именно в формальной математике, в таких областях, как автоматическое доказательство теорем, символьная математика, автоматические вывод и рассуждения и т. д. Однако и тут возникает такая же возможность для критики, как и в случае интуитивного подхода, – где возникает сознание, в какой момент интеллектуальная система начинает осознавать себя. И как бы хорошо она ни манипулировала символами, ответить на этот вопрос на сегодняшний день возможным не представляется. Мы ещё вернёмся к этому аспекту в главе про философию сознания и искусственного интеллекта, а пока перейдём к следующему подходу.

Структурный подход, или коннекционизм, исходит из понимания того, что интеллект, разум и сознание являются функцией сложности сети переплетённых и взаимодействующих базовых элементов. Поскольку нервная система человека состоит из нейронов и ряда других специальных клеток, то основой структурного подхода в искусственном интеллекте является использование искусственных нейронных сетей.

Здесь уже упоминалось, что первый искусственный нейрон был разработан Уорреном Мак-Каллоком и Уолтером Питтсом в первой половине XX века. Также в то время Фрэнком Розенблаттом была разработана первая архитектура искусственных нейронных сетей – перцептрон. Фактически это самые первые примеры математических моделей и программных систем, разработанных в духе коннективизма. И здесь необходимо отметить, что в процессе развития перцептронов появились некоторые расширения первоначальной модели, предложенной Ф. Розенблаттом. Самый простой классификатор основан на количестве слоёв в перцептроне: однослойный, с одним скрытым слоем (классический) и многослойный. Все эти типы были в своё время описаны самим Ф. Розенблаттом.

Другая классификация включает: элементарный перцептрон, простой перцептрон, перцептрон с последовательными связями, перцептрон с перекрёстными связями, перцептрон с обратными связями, перцептрон с переменными связями. Первые три класса были описаны Ф. Розенблаттом, а следующие три развиты в дальнейшем при детальной проработке модели искусственных нейронных сетей.

Итак, структурный подход основан на идее о том, что наиболее важной для эмерджентного проявления разума и других подобных функций вплоть до сознания является сетевая структура. Это значит, что моделирование должно затрагивать не только базовые элементы типа нейронов, но и их взаимосвязанные сети. При этом полагается, что сеть элементов как сложная система обладает нелинейными свойствами относительно базовых элементов, а потому при увеличении количества взаимосвязанных элементов сложность модели изменяется нелинейно и зачастую даже непредсказуемым образом, так что при переходе некоторого порога сложности как раз и начинают проявляться те самые эмерджентные эффекты, которых мы так ждём. До сегодняшнего дня главным и фактически единственным представителем структурного подхода являются искусственные нейронные сети.

Эволюционный подход реализует так называемую «искусственную эволюцию» и фактически решает оптимизационную задачу поиска значения целевой функции в заданном пространстве решений с установленными ограничениями. Этот подход содержит большое количество эвристических методов, некоторые из которых используются даже для гарантированного нахождения оптимума для мультимодальных недифференцируемых функций в пространствах высоких размерностей. Важным методом эволюционного подхода являются генетические алгоритмы, которые мы рассмотрим чуть позже. Но здесь также есть несколько других важных методов, в числе которых находятся эволюционное программирование и даже нейроэволюция, когда искусственному отбору подвергаются нейронные сети.

Итак, в рамках эволюционного подхода обычно выделяют следующие технологии и методы: эволюционное программирование, генетическое программирование, эволюционные стратегии, генетические алгоритмы, дифференциальная эволюция и нейроэволюция. Другими словами, а что, если вычислительные процессы могли бы эволюционировать так же, как это делают биологические виды в своей экологической среде? Возможно, получилось бы «выращивать» программы для оптимального решения поставленной задачи? Эволюционное программирование как раз и основано на этой идее.

Если же в качестве объектов отбора выступают сами программы, то получается уже генетическое программирование. Ведь, действительно, программы пишутся на определённом языке программирования и в конечном итоге представляют собой строки символов. Эти строки можно подвергнуть генетическим преобразованиям и отбору. Эта очень мощная идея получила своё развитие в том, что программы начали писать и оптимизировать другие программы, и уже исследователи, запустившие процесс, не могут разобрать и интерпретировать полученные исходные коды, которые работают правильно и часто очень эффективно.

Генетические алгоритмы – это наиболее яркий представитель эволюционного подхода. Сами по себе они опять являются одним из эвристических методов оптимизации для поиска оптимального решения (или, как минимум, субоптимального). Они работают с данными, которые могут быть представлены в виде «хромосом» – последовательностей генов, т. е. списков каких-либо значений, к которым можно применить генетические операции. Здесь главное – чтобы на генах были определены эти самые генетические операции, которые возвращали бы приемлемый результат, имеющий смысл.

Мы ещё детально ознакомимся с эволюционными алгоритмами и вообще эволюционным подходом во второй главе.

Идём дальше и кратко коснёмся квазибиологического подхода и его методов. Фактически это отдельное направление исследований в искусственном интеллекте, так как оно основано не на цифровом моделировании in silico разных аспектов интеллекта, а на применении биомолекулярных механизмов для того же самого. Этот подход ещё называется «биокомпьютингом», и это очень перспективное направление. В рамках квазибиологического подхода разработано большое количестве методов – начиная от биомолекулярной электроники, молекулярных вычислений и заканчивая нейрокомпьютингом. В последнем направлении важной вехой является разработка нейроморфных чипов. И иногда мне кажется, что прорыв в области искусственного интеллекта будет лежать на пересечении трёх областей – техники, информатики и химии. Но посмотрим…

В основе этого подхода лежит понимание, что феномены человеческого поведения, наша способность к обучению и адаптации есть следствие именно биологической структуры и особенностей её функционирования. Хотя, скорее всего, это очень слабая гипотеза. Вычисления в рамках квазибиологического подхода организуются при помощи живых тканей, клеток, вирусов и различных биомолекул. Часто используются молекулы дезоксирибонуклеиновой кислоты, на основе которой создают ДНК-компьютер. Кроме ДНК, в качестве биопроцессора могут использоваться также белковые молекулы и биологические мембраны.

Обычно для решения определённой задачи создаётся так называемая «индивидуальная машина», которая, в отличие от универсальной машины Тьюринга, направлена на решение конкретной задачи, причём обычно делает это более эффективным способом, поскольку индивидуальная машина специально сконструирована для решения именно этой задачи. Машина Тьюринга, лежащая в основе стандартной вычислительной модели, выполняет свои команды последовательно, а в рамках квазибиологической парадигмы часто рассматривается массовый параллелизм. Ну вот если, к примеру, рассмотреть ДНК-компьютер, то в нём все молекулы ДНК одновременно участвуют во взаимодействиях, параллельно проводя вычисления.

Два самых главных направления в рамках квазибиологического подхода – это молекулярные вычисления и биомолекулярная электроника. Можно ещё упомянуть нейрокомпьютинг и создание нейроморфных чипов, но они чаще всего рассматриваются как часть структурного подхода и искусственных нейронных сетей.

Молекулярные вычисления – это отдельная вычислительная модель, в которой решение задачи осуществляется при помощи проведения сложных биохимических или нанотехнологических реакций. Молекулярные компьютеры – это молекулы, запрограммированные на нужные свойства и поведение, которые, участвуя в химических реакциях, как бы «выращивают» результат. Что интересно, идею биокомпьютинга подсказал выдающийся математик Джон фон Нейман в своей книге «Теория самовоспроизводящихся автоматов», которую, кстати, очень рекомендую для внимательного чтения. В этой книге описан проект клеточных автоматов, которые могут самовоспроизводиться, как живая клетка.

Почти в каждой живой клетке нашего организма есть длинная молекула ДНК, кодирующая генетическую информацию. При помощи различных ферментов цепочки ДНК могут быть разрезаны, склеены, в них могут добавляться буквы генетического кода или удаляться из них. Всё это – базовые операции работы с информацией, которые могут быть использованы для производства вычислений. Более того, цепочки ДНК могут воспроизводиться и клонироваться. Это позволяет запустить массовый параллелизм поиска решения. В небольшой пробирке после проведения должным образом сконструированной биохимической реакции будет получен результат, который считывается специальной аппаратурой.

Интерес вызывает то, что для некоторых задач молекулярные компьютеры очень быстро и точно находят приемлемые решения, в то время как традиционные компьютеры затрудняются это сделать. Например, решение задачи коммивояжёра, т. е. поиска кратчайшего пути обхода графа, при помощи реакций с ДНК осуществляется практически мгновенно, в то время как для обычного компьютера требуется огромное количество времени. Правда, тут есть одна тонкость, которая мешает работе обычному компьютеру, – это комбинаторный взрыв. И если в традиционной архитектуре он ведёт к увеличению времени решения, то для ДНК-компьютера требуется подготовка огромного количества вариантов нуклеотидных нитей. Соответственно, объём пробирки растёт так же, как и количество вариантов в комбинаторном взрыве.

В общем, часто биокомпьютинг можно охарактеризовать как новую парадигму вычислений, которая, в отличие от традиционной вычислительной модели, работает быстро, но при решении сложных задач с комбинаторным взрывом растёт не время вычислений, а необходимый для них объём биокомпьютера.

Вместе с тем в последнее время всё активнее разрабатывается агентный подход к построению искусственного интеллекта. В рамках этого подхода изменена точка зрения на цель построения интеллектуальной системы и считается, что построить нужно систему не с разумным поведением, а с рациональным. С одной стороны, это серьёзно облегчает задачу, поскольку, в отличие от понятий «разум» или «интеллект», понятия «рациональность» и «рациональное поведение» можно строго формализовать (например, рациональное поведение – это выбор и достижение оптимальной цели с минимизацией затраченных на это ресурсов). С другой стороны, для демонстрации рационального поведения агент должен обладать достаточной «разумностью», чтобы определить цель, составить стратегию её достижения и выполнить её.

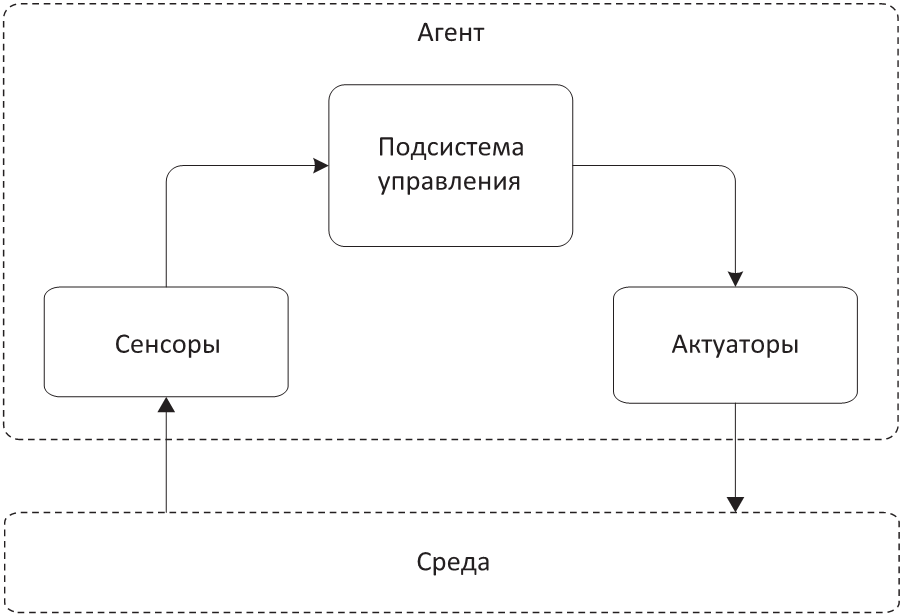

Каждый агент – это полноценная кибернетическая машина, которая имеет систему управления, непрерывно получающую информацию с сенсорных систем агента и воздействующую на окружающую среду при помощи исполнительных устройств (или актуаторов). При этом подход не определяет сущность сенсорных систем и актуаторов – их природа может быть произвольной. Поэтому агентный подход одинаково применим как к чисто программным сущностям, работающим в некоторой искусственной среде, так и к программно-аппаратным комплексам, равно как и вообще к биологическим системам.

Общая схема агента и его взаимодействия со средой

Агентный подход интересен тем, что в его рамках можно использовать эволюционные алгоритмы, которые подбирают интеллектуальных агентов, исходя из степени их приспособленности к достижению цели. Во время взаимодействия агентов осуществляется отбор наиболее успешных, которые затем используются для генерации нового поколения агентов, среди которых опять применяются те же самые процедуры оценки и отбора. В итоге наиболее успешное поколение решает задачи и достигает целей наиболее эффективным образом. Это идеальный вариант, который сегодня сложно достижим, но стремиться к нему интересно. Также агентный подход лежит в основе так называемых многоагентных систем, в рамках которых осуществляется общее целеполагание, после чего каждому индивидуальному агенту даётся свобода действий в определённых рамках, где он имеет возможности и альтернативы по разработке и реализации различных стратегий достижения своей частной цели. В процессе этого агенты взаимодействуют друг с другом и со средой, обмениваясь информацией и выполняя запросы других агентов. Кроме того, вполне может быть использована идея так называемого «роевого интеллекта», когда каждая отдельная «особь» (то есть агент) интеллектом не обладает, но в целом «рой» (множество агентов, многоагентная система) обладает определёнными интеллектуальными способностями. Надо отметить, что всё перечисленное является одним из наиболее перспективных направлений исследований по искусственному интеллекту.

* * *

Итак, философия сознания, начавшаяся развиваться вместе с более «взрослым» пониманием задач и проблем искусственного интеллекта, выделяет два крупных подхода к построению интеллектуальных систем и искусственных разумных существ: чистый (нисходящий) и грязный (восходящий). Чистый подход объединяет такие технологии, как экспертные системы, универсальные машины вывода, семиотические базы знаний. Самым выдающимся и далеко продвинувшимся направлением в рамках этого подхода является направление символьных вычислений, которое основано на логике манипулирования символами. Грязный подход объединяет такие технологии, как искусственные нейронные сети, эволюционные вычисления и биокомпьютинг. Грязный подход моделирует биологические основы разума у человека, в то время как чистый подход имитирует высокоуровневые психические и когнитивные процессы: мышление, рассуждение, речь, эмоции, творчество и т. д.

Однако, как уже было описано выше, и чистый, и грязный подходы имеют как достоинства, так и свои недостатки. В частности, нейронные сети и все смежные технологии обладают очень существенными ограничениями.

1. Наука до сих пор не обладает полным пониманием того, как обучается нейронная сеть. Теоретический математический аппарат, конечно, имеется, однако при переходе в практическое русло вычислительная сложность интерпретации того, как и, главное, почему нейросеть настроила свои весовые коэффициенты так, а не иначе, нелинейно возрастает до космических величин. И в итоге получается чёрный ящик в качестве модели чёрного ящика. Это совсем не то, что нужно.

2. Часто в нейронную сеть для обучения попадают некорректные данные, которые выглядят как валидные. Например, в медицинской проблемной области нередко случается так, что диагнозы ставятся неверно, лекарственные средства назначаются неадекватно, а потому нет никакой гарантии того, что при обучении нейросети ей не «скармливаются» такие некорректные данные. Принцип GIGO никто не отменял. Кто даст гарантию того, что обученная на некорректных данных нейросеть даст правильное заключение, а инструмента интерпретации того, как она обучилась, нет.

3. В процессе развития человеческих знаний всегда появляется новая информация, которая часто не дополняет, а заменяет старую. Человек-эксперт постоянно актуализирует свои знания, занимаясь самообразованием и повышением квалификации. Как поступать с нейросетью? Ведь невозможно проинтерпретировать то, как она обучилась, а потому нет никакого способа точечно заменить устаревшую информацию. Сеть приходится переобучать с нуля.

4. Более того, «углеродная» нейросеть фундаментально отличается от «кремниевой» – сегодня ещё не разработано окончательной рабочей модели того, как обучается человек. С учётом непрекращающегося нейрогенеза в отдельных областях головного мозга есть понимание, что в нейросетях в голове человека могут появляться не только новые отдельные нейроны, но и даже целые слои. Впрочем, и нейроны, и слои также могут исключаться из процесса вычислений. И если появление и исключение синаптических контактов можно эмулировать весовыми коэффициентами в искусственных нейронных сетях, то про искусственные модели с появлением новых слоёв пока слышно очень редко и тихо. 5. К тому же центральная нервная система человека представляет собой не обычную многослойную нейросеть, а десятки отдельных сетей, связанных друг с другом. Иногда связанных совсем нелинейным образом – с кучей реципрокных и обратных связей, которые могут выходить и входить в промежуточные слои любой сети. Сигнал от сенсора до исполнительного устройства в человеке может пройти через десяток коммутирующих ядер, запустить параллельные процессы и в итоге так и не дойти до неокортекса, оставшись в подсознательной области.